Quello che Walter Veltroni non capisce dell'AI, e perché ci importa

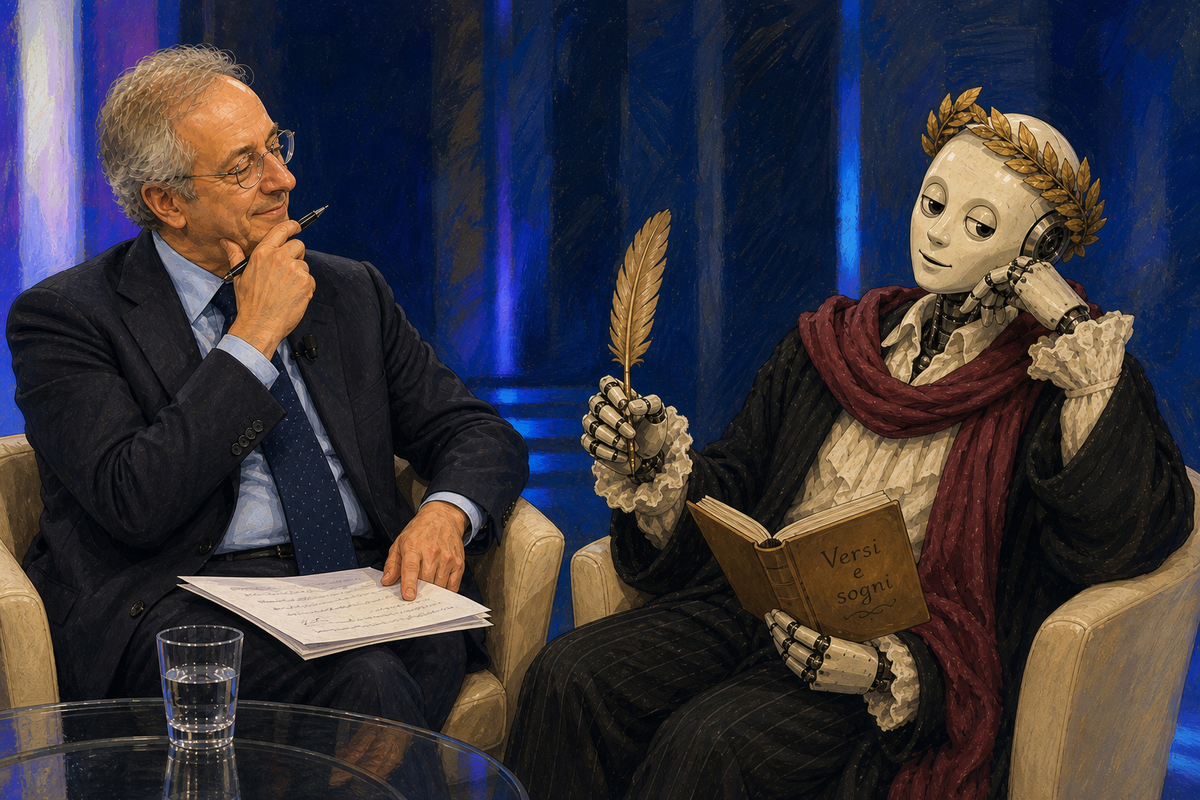

La maldestra "Intervista" a Claude di Veltroni ci mostra bene un paio di equivoci importanti su come non dovremmo parlare di AI

Il primo maggio è uscita sul Corriere della Sera un articolo bizzarro: una "intervista" di Walter Veltroni a Claude, l'AI di Anthropic.

Non solo è un'intervista strana, ma mostra da una parte l'ignoranza di Veltroni sugli LLM, e dall'altra prosegue un filone problematico su come concepiamo i chatbot. Allora analizziamolo in breve.

L'intervista segue probabilmente il filone dell'intervista di Bernie Sanders a Claude di un mesetto fa. Entrambe hanno dei problemi in comune nell'approccio, con la differenza che quella di Sanders in video ha una regia interessante ed è un po' più pratica.

Ho deciso di raggruppare le domande di Veltroni in 4 categorie, dalla più ininfluente alla più grave, per spiegare i problemi dell'articolo.

Domande noiose

Nel lungo articolo (sono circa 32mila battute) c'è ampio spazio per delle domande che trovo siano semplicemente...noiose, quelle in cui viene chiesta a Claude una "opinione" su qualcosa di ininfluente:

questo post è disponibile per chi si iscrive gratuitamente alla newsletter!👇